1. 引言

及时、准确地交通流分析和预测是建设现代化智慧城市过程中必不可少的部分。交通流量预测作为智能交通系统(ITS)的重要组成部分 [1],它对于城市交通规划,交通管理和交通控制具有非常重要的意义。通过提前准确地对车流量进行预测,交通管理部门就能事先对车辆进行疏导,可以提高路网的运行能力和效率,减少交通事故的发生,降低人们的出行时间和成本,降低环境污染。传统的交通流量预测方法简单地采用时间序列模型,例如历史均值(HA) [2],向量自回归(VAR) [3] 模型等机器学习方法。然而,这些方法依赖于理想的平稳假设,这对于高度的非线性和复杂性的流量数据往往不合乎实际情况。最近,深度学习的方法受到了研究者们的青睐,深度递归神经网络(RNN)及其改进方法,例如长短期记忆网络(LSTM) [4] 已被广泛应用于从大量的序列信息中学习其中潜在的模式。然而,该模型将来自不同道路的交通信息视为独立的数据流,这就忽略了交通数据中的空间关系。因为交通数据可以表示为道路网络上的时间序列,其中道路之间的连接性是根据道路之间的空间邻近性和模式的相似性来决定的。因此,图卷积神经网络进入了研究者们的视线,并逐渐成为交通领域热门的研究点,如 [5] [6] [7] [8] 被提出以捕捉交通流中的时空信息,结合了循环神经网络和图卷积神经网络来建模交通流量中的空间和时间依赖关系。

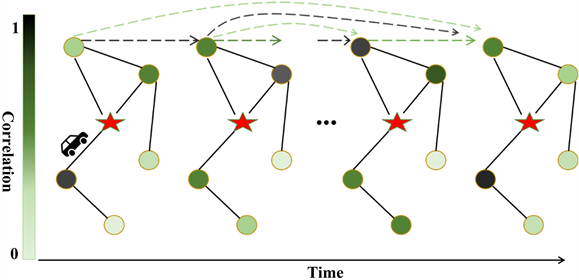

在智能交通领域,交通流量预测是一种典型的时空图数据挖掘问题。图1表示了交通流量复杂的时空关系。节点表示分布在城市道路上的传感器,红色五角星节点表示预测结果,节点颜色越深表示对目标节点的空间关系影响越大,相应的虚线颜色深浅表示时间关系的影响大小。具体地,第一,在空间维度上,图1显示不同节点对预测目标节点的影响是不同的,而且相同节点对预测目标节点的影响也是随时间变化的。可见,不同道路节点之间的空间相关性是非线性的和高度动态的。第二,在时间维度上,交通流量具有动态时间依赖性。如图1所示,同一节点不同时刻的观测值呈现非线性变化,相邻时间节点之间的交通流量存在很强的相似性,然而较远时间节点的交通状态对预测时间节点的影响有时要大于较近时间点的影响。最后,交通流量在时空维度都存在很强的动态相关性,而且这种高度动态的时空相关性是同时存在的。因此,如何从这些非线性的时空数据中挖掘出这些复杂的时空相关性,是时空图数据挖掘任务的一项极大挑战。

Figure 1. The complex spatial-temporal correlations of traffic flow

图1. 交通流量复杂的时空关系

为了解决上述问题,我们提出了一种新的基于图注意力网络的深度学习模型,以有效地捕获道路交通流中复杂的时空依赖关系。本文的主要贡献:

· 我们提出了一种新颖的面向交通流量预测的时空图注意力网络(STGAL)。该模型能够更加准确提取交通流动态和静态的时空特征,有效解决交通流量预测问题。

· 我们不仅考虑邻域节点的特征和边的权重来生成新的节点表示,而且考虑交通流动态变化的时空模式。使用图注意力网络对邻域节点进行有区别的信息聚合;使用时空注意力块,用于捕捉交通流中动态变化的时空关系。

在多步交通预测任务上的大量实验,通过与各种基准方法对比分析,证明了我们的方法(STGAL)的有效性和优越性。

2. 研究方法

2.1. 问题定义

交通流量预测是根据历史交通流量数据特征来预测未来的交通流量。进一步,历史交通流量数据被表示为交通图网络上的时间序列。交通图网络定义为无向图

,其中V为图上的节点集(文中是指交通道路上分布的传感器),

是节点数目,E为边集,表示节点V之间的连接关系,

是图G的邻接矩阵,表示节点V间的空间关系。因此,历史交通流量数据就可以表示为

作为输入的长度T的交通序列,我们的核心目标是为了通过训练找到一个函数即F来预测下一个时间步长p,表示为

,具体地定义公式如下所示,其中

是可学习的参数:

(1)

2.2. 模型设计

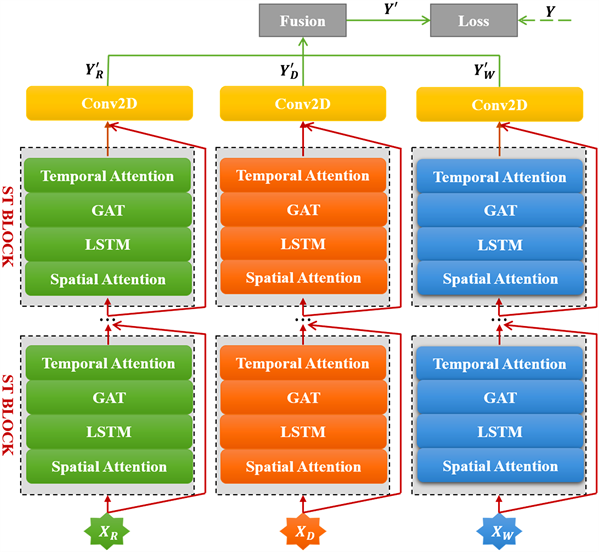

图2给出了本文提出的STGAL模型的总体框架。它由三个结构相同的独立组件组成,分别对历史数据的近期相关性、日周期相关性和周周期相关性进行建模。每一个组件包含相同的时空模块并通过残差连接。具体来说,空间注意力用来提取动态的空间关系,长短期记忆网络提取时间相关性,图注意力网络用来提取空间相关性,时间注意力提取动态的时间关系。输出层采用2-D卷积神经网络进行多步输出。最后,我们将所有组件的卷积输出相加作为我们模型的预测,并采用均方根误差即MSE损失来衡量预测与它的实际情况之间的差异。接下来我们将会详细描述ST BLOCK中的每一个模块以及多个组件融合的方法。

Figure 2. The framework of the spatial-temporal graph attention networks for traffic flow forecasting (STGAL)

图2. 基于时空图注意力网络的交通流量预测模型框架(STGAL)

2.2.1. 空间注意力网络

一条道路的交通状况会受到其他道路不同程度的影响。这种影响是高度动态的,随着时间的推移而变化。为了对这些属性进行建模,我们使用一种注意力机制 [9] 自适应地学习空间维度中节点之间的动态相关性。其关键思想是在不同的时间步长为不同的顶点动态分配不同的权重。为了稳定学习过程,我们将空间注意机制扩展为多头注意机制。计算公式如下:

(2)

(3)

其中

是空间注意力机制输入的特征序列,

是可学习的参数,

表示节点i和节点j之间的关联强度,然后使用Softmax函数来确保节点的关注权重系数和为1。通过空间注意力机制我们可以得到空间关注度矩阵

来提取交通流量动态的空间关系。

2.2.2. LSTM网络

交通流量有非常强的时间相关性,尤其是相近的交通流量情况往往有着相似的模式。我们使用RNN的强大变体LSTM [4] 来提取交通流量的时间相关性。在该模型中,原来的LSTM中的门结构和隐藏状态保持不变,但输入用空间注意力的输出

取代,定义如下:

(4)

(5)

(6)

(7)

(8)

(9)

其中 是矩阵乘法运算符。

是权重矩阵,将输入

映射到三个门和输入单元状态。

和

是前一隐藏状态的权重矩阵。

是四个偏置向量。

分别是LSTM的遗忘门、输入门和输出门。

为LSTM的状态。通过长短期记忆网络我们可以有效提取交通流的时间关系。

2.2.3. 图注意力网络

图卷积网络被广泛应用于挖掘交通道路网络中节点之间的空间关系,但是标准的图卷积在计算过程中使用相同的卷积核参数,使得相邻节点的信息均匀地聚集到给定的中心节点。然而,这往往与事实情况不符合。道路节点之间的影响情况非常复杂,交通流量往往会受早晚高峰、天气、车道数、路况、车辆密度和交通事故等因素的影响。这导致了各个邻居节点对中心节点的影响是各不相同的。图注意力网络(GAT) [10] 提出了一种利用注意力机制对相邻节点特征进行加权求和的方法。特征节点的权重完全依赖于节点的特征,并且与图的结构无关。该方法克服了基于谱图卷积网络的瓶颈,易于实现向不同邻域分配不同的学习权值。在这里我们采用多头注意机制来增强模型的能力,稳定训练过程。定义如下:

(10)

(11)

(12)

其中W是节点特征变换的权重参数,

是计算两个节点相关度的函数,

和

是LSTM的隐藏层输出,LeakyRelu为激活函数,

是两个节点之间的注意力得分,

是第k组注意力机制计算出的权重系数,

是可学习的参数。我们建议对K个输出取平均得到最终的结果

。

2.2.4. 时间注意力网络

除了捕捉动态的空间关系,在时间维度上,不同时间段的交通状况之间存在相关性,并且在不同的情况下这种相关性也是不同的。因此我们还需要时间注意力机制 [11] 来关注交通流量长期的动态时间关系。定义如下:

(13)

(14)

其中

都是可学习的参数。

是第k组注意力机制计算出的时间i和时间j之间的关联强度。同样地使用Softmax函数来确保时间节点的关注权重系数和为1。通过时间注意力机制我们可以提取到交通流的动态时间相关性。

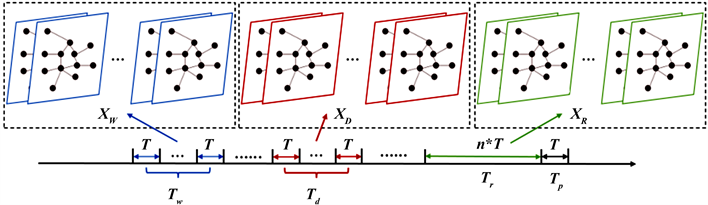

2.2.5. 多组件融合方法

图3给出了对原始数据周期性特征的提取。输入数据的特征与最近、每日和每周观测的交通数据密切相关。如图所示,我们沿着时间轴截取长度为

、

、和

(T为采样的时间长度,n为正整数)的三个时间序列段,分别作为最近周期数据

,日周期数据

,即过去几天同一预测时刻的采样数据,周周期数据

,即过去几周同一预测时刻的采样数据。因此,我们采用了一种基于参数矩阵的方法来融合STGAL中的三个组件(最近,每日和每周交通流模式),如下所示:

(15)

其中,

是学习参数,表示其对预测目标的影响程度;

是矩阵对应元素相乘的哈达马乘积;

分别是近期,日周期,周周期3个组件的输出。

Figure 3. Example of the input time series construction

图3. 输入时间序列片段构建示例

3. 实验

3.1. 实验数据集

我们在两个真实交通数据集 [8] PeMSD4和PeMSD8上进行实验。这些数据来自Caltrans Performance Measure System。每30秒实时收集一次,原始交通流量数据被聚合成5分钟间隔,这意味着每小时的流量数据中有12个点。我们使用过去一小时的交通流量数据来预测下一小时的流量情况。数据集中的缺失数值通过线性插值来填充。通过标准归一化方法将数据集标准化,使训练过程更加稳定。关于这两个数据集的详细统计信息如表1所示。

Table 1. Description of experimental datasets

表1. 实验数据集描述

3.2. 评价指标

为了评估交通预测模型的预测性能,我们主要测量预测值与真实值之间的误差。误差越小,预测值越接近真实值。由于不同区域的交通情况可能不同,使用绝对误差可能表明模型对相对简单的样本进行过拟合,而平方误差对困难和不可预测的样本惩罚更多,可以更好地表现复杂情况下的性能。因此,我们采用了三个广泛使用的度量:平均绝对误差(MAE)、均方根误差(RMSE)和平均绝对百分比误差(MAPE)来衡量预测模型的性能,它们数值越小,预测效果越好。

(16)

(17)

(18)

3.3. 实验设置

为了评估我们模型的整体性能,我们将STGAL与广泛使用的基线和最先进的模型进行了比较,包括1) HA [2]:历史平均法。我们使用最后12个时间片的平均值来预测下一个值。2) VAR [3]:向量自回归是一种先进的时间序列模型,它能够捕捉时间序列之间的成对关系。3) LSTM [4]:用于时间序列预测的长期短期记忆网络,是循环神经网络改进的变体。4) DCRNN [5]:扩散卷积递归神经网络利用扩散图卷积网络和序列到序列结构分别对空间信息和时间信息进行编码。5) STGCN [6]:完全使用卷积结构来捕获空间和时间特征,其时空卷积模块结构类似三明治,上下是时间卷积,中间是空间卷积。6) Graph Wave-Net [7]:它引入了自适应的图建模方法,充分考虑了现实世界中的复杂关系及不确定性,结合了图形卷积和扩张的随意卷积来捕获时空依赖关系。7) ASTGCN [8]:基于注意力的时空图卷积网络使用三个组件对时间序列上的近期、日周期、周周期三个模式进行建模。在K阶切比雪夫多项式展开的图卷积内融入了注意力机制来捕获空间动态性,在时间维度上使用注意力机制捕获动态时间关系。

所有基于深度学习的模型,包括我们的STGAL,都是用Python3.8和Pytorch 1.6.0实现的。并在带有一个NVIDIA GTX 2080Ti的GPU服务器上执行。我们使用ADAM优化器对所有模型进行优化,对于超参数,我们将所有模块的隐藏单位设置为64,批量大小设置为16。我们选择均方误差MSE作为模型的损失函数,最初的学习速率设置为0.0005,学习速率的衰减效率设置为0.92。所有深度学习模型的最佳参数都是通过对验证集进行仔细的参数调整来选择的。

3.4. 实验结果及分析

将我们的模型与PeMSD4和PeMSD8上的上述七种有代表性的基线方法进行了比较。表2显示了未来一小时即12个预测步长的交通流量预测性能的平均结果。我们可以观察到:1) 基于GCN的方法优于HA、VAR传统的机器学习方法和LSTM深度学习方法,说明了显式建模空间相关性的重要性和GCN在交通流预测任务中的有效性;2) 我们的方法进一步改进了基于GCN的方法,并取得了显著的效果。STGAL对PeMSD4和PeMSD8数据集的MAE和MAPE的现有最好结果进行了5%以上的相对提升,以及对PeMSD4和PeMSD8数据集的RMSE的现有最好结果进行了3%以上的相对提升,特别是对PeMSD4数据集的MAE的现有最好结果有着高达8.76%的相对提升。3) 实验结果表明,STGAL能够更加准确捕捉交通流量序列中的时间和空间相关性,并取得最好的预测效果。

Table 2. Performance of STGAL and baseline models for PeMSD4 and PeMSD8

表2. STGAL以及基准方法在数据集PeMSD4和PeMSD8上的性能表现

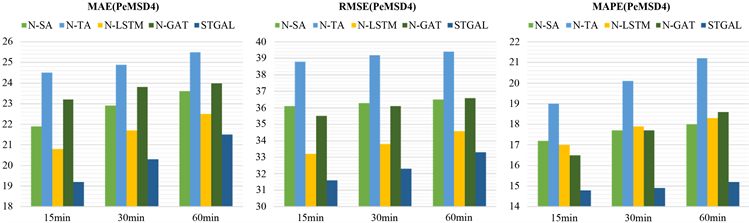

3.5. 消融研究

为了进一步研究STGAL不同模块的影响,我们进行了全面的消融研究,我们设计了STGAL模型的四个变体。具体来说1) N-SA:去掉STGAL中的空间注意力模块;2) N-TA:去掉STGAL中的时间注意力模块;3) N-LSTM:去掉STGAL中的长短期记忆网络;4) N-GAT:这里是用标准的图卷积网络来代替我们STGAL中的多头图注意力网络。

我们将这四个变体和STGAL在PeMSD4和PeMSD8上进行实验,如图4、图5所示。我们可以观察到:1) N-TA的各个评价指标都处于最大值,即时间注意力模块对两个数据集的影响最大,说明了用时间注意力来提取交通流长期的动态的时间相关性是非常有必要的。2) 去掉空间注意力模块,STGAL的实验效果明显降低,我们推测其原因是空间注意力提取了交通流的动态空间相关性,符合了现实中交通流动态变化的事实。3) 用标准的图卷积网络代替多头图注意力网络,模型的性能在两个数据集上都表现很差,是因为标准的图卷积网络在卷积计算的过程中共享卷积核参数,使得邻居节点的信息被均匀地聚合到中心节点上,而GAT网络可以对邻域节点进行有区别的信息聚合,它不仅考虑邻域节点的特征和边的权重来生成新的节点表示,而且考虑交通流动态变化的时空模式。4) 与四个变体相比较,STGAL具有最佳的性能。一方面表明了STGAL中各个模块的重要性,另一方面说明了STGAL能够更加准确提取交通流量序列中的时空相关性。

Figure 4. Ablation study on PeMSD4

图4. 在PeMSD4上的消融研究

Figure 5. Ablation study on PeMSD8

图5. 在PeMSD8上的消融研究

4. 结语

本文提出了一种新颖的面向交通流量预测的时空图注意力网络STGAL。我们使用图注意力网络和长短期记忆网络来提取城市道路中交通流量的静态的时空关系,而且我们使用空间和时间注意力网络来捕捉交通路网节点中动态变化的时空关系。在多步交通预测任务上的大量实验结果证明了STGAL以及它的各个模块的有效性和优越性。在下一步的工作中,我们将会研究所提出的模型是否可以应用于解决其他的时空数据挖掘问题,例如时空车辆轨迹数据的挖掘任务。

基金项目

云南省软件工程重点实验室开放基金资助项目(2020SE404)。

NOTES

*第一作者。

#通讯作者。